Ab August 2026 musst du KI-generierten Content kennzeichnen. Nicht vielleicht. Nicht „wenn die Behörden das irgendwann durchsetzen". Sondern verbindlich, auf Basis von EU AI Act Art. 50. Und ganz ehrlich: Die meisten Content-Teams, die ich kenne, sind darauf noch nicht vorbereitet. Nach 26 Jahren in der digitalen Produktentwicklung und der Begleitung von über 200 KI-Startups bei AI NATION sehe ich das Gleiche immer wieder: Unternehmen optimieren ihre KI-Workflows für Geschwindigkeit, ignorieren aber die rechtliche Seite komplett. Das ist ein teurer Fehler.

Was die meisten Guides vollkommen übersehen: Es geht nicht nur um eine Kennzeichnungspflicht. Es geht um drei Rechtsgebiete gleichzeitig, die ineinandergreifen. Urheberrecht. EU AI Act. DSGVO. Und kein einziger Artikel da draußen verbindet alle drei aus der Perspektive eines Content-Teams. Das machen wir heute. Konkret, mit Checkliste, ohne Juristendeutsch.

Kurze Antwort: Ja, du darfst KI-Texte veröffentlichen, aber ab August 2026 greift die Kennzeichnungspflicht nach EU AI Act Art. 50, das Urheberrecht an KI-generierten Texten liegt beim menschlichen Bearbeiter, und bei der Texterstellung gelten DSGVO-Regeln für eingegebene Personendaten.

⚡ TL;DR – Die wichtigsten Erkenntnisse:

- ✅ KI-generierte Texte sind nicht automatisch urheberrechtlich geschützt, aber deine redaktionelle Bearbeitung schon.

- ✅ Ab August 2026 gilt EU AI Act Art. 50: Kennzeichnungspflicht für KI-Content, außer du kannst „Human-in-the-Loop" nachweisen.

- ✅ DSGVO greift, sobald personenbezogene Daten in KI-Systeme eingegeben werden, also immer prüfen, was du in den Prompt schreibst.

- ✅ Bußgelder bei Verstößen gegen den EU AI Act können bis zu 15 Mio. Euro oder 3 % des weltweiten Jahresumsatzes betragen.

Wer hat das Urheberrecht an KI-generierten Texten?

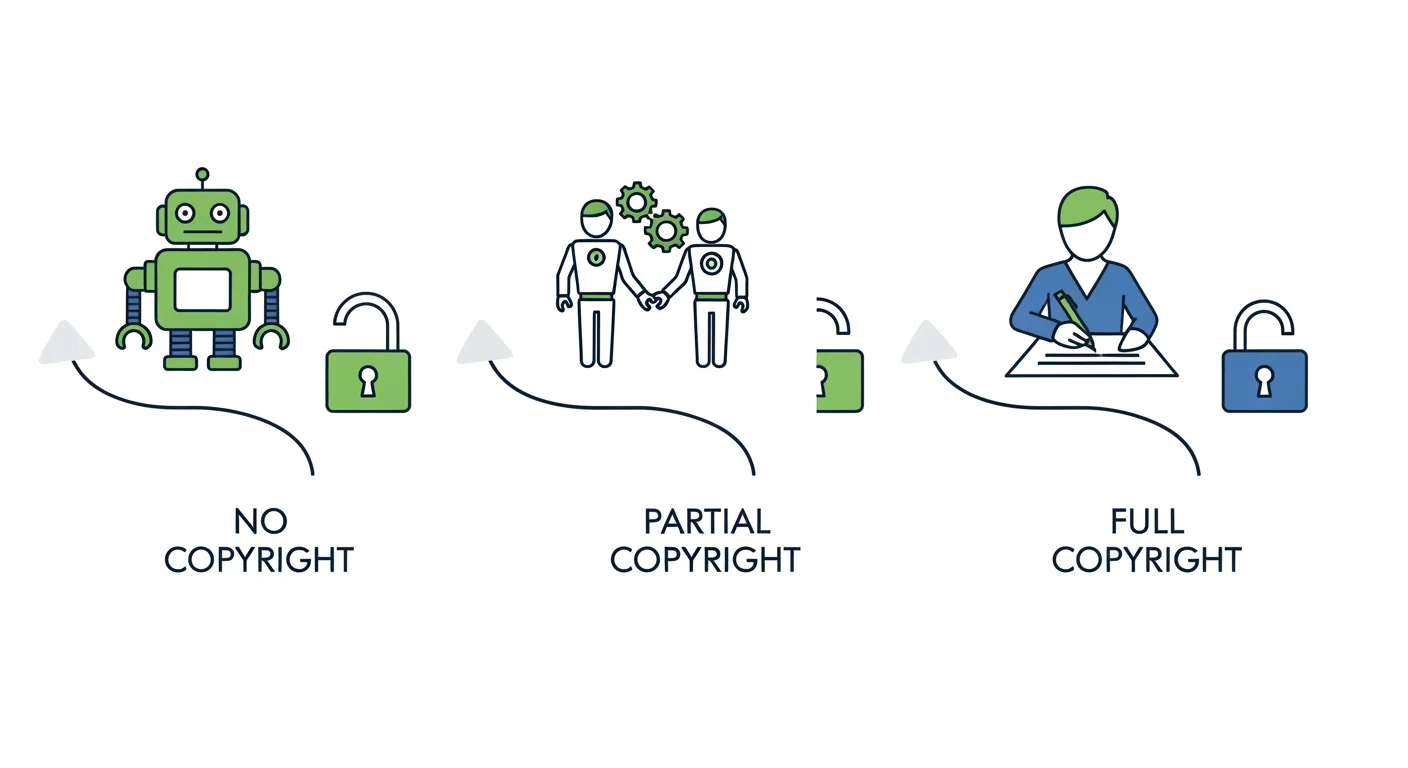

Hier ist das Ding: Rein KI-generierter Text ist in Deutschland und Österreich urheberrechtlich nicht geschützt. Warum? Weil das Urheberrecht eine menschliche Schöpfungshöhe voraussetzt. Ein Sprachmodell hat keine Persönlichkeit, keine schöpferische Absicht im Rechtssinn. Das sagt nicht irgendwer, das ist die herrschende Meinung im deutschen Urheberrecht, basierend auf § 2 UrhG.

Aber jetzt kommt der Haken. Wenn du den KI-Output redaktionell bearbeitest, strukturierst, mit eigenen Gedanken anreicherst und eine individuelle Gestaltung reinbringst, dann kann dieses Ergebnis urheberrechtlich geschützt sein. Und zwar durch dich als menschlichen Bearbeiter. Das ist ein riesiger Unterschied, den viele Content-Teams nicht auf dem Schirm haben.

Was bedeutet das praktisch? Drei Szenarien:

- Szenario 1 – Reiner KI-Text, unbearbeitet veröffentlicht: Kein Urheberrechtsschutz. Jeder kann ihn kopieren, und du kannst nichts dagegen tun.

- Szenario 2 – KI als Rohfassung, redaktionell überarbeitet: Schutzfähig, wenn die menschliche Bearbeitung ausreichend kreativ ist. Du bist Urheber des bearbeiteten Werks.

- Szenario 3 – KI unterstützt Recherche, du schreibst selbst: Voller Urheberrechtsschutz wie bei herkömmlichem Text.

Laut einer Umfrage aus 2025 nutzen nur noch 23,9 % der Autor:innen KI tatsächlich zur Textgenerierung, während 74,3 % sie für Recherche einsetzen (Börsenblatt, 2025). Der Markt hat die reine KI-Texterstellung also schon teilweise verworfen. Aus gutem Grund.

In der Schweiz ist die Rechtslage ähnlich, aber noch nicht höchstrichterlich geklärt. Die KOF-Studie 186 der ETH Zürich (Oktober 2025) warnt vor zunehmenden Arbeitsmarkt- und Rechtsverschiebungen durch generative KI, ohne dass der Rechtsrahmen Schritt hält. Das gilt es im Blick zu behalten, besonders wenn du für DACH-Märkte arbeitest.

EU AI Act Art. 50: Was bedeutet die Kennzeichnungspflicht ab August 2026?

Ganz ehrlich, dieser Abschnitt ist der wichtigste im ganzen Artikel. Also lies ihn genau.

Art. 50 des EU AI Acts regelt die Transparenzpflichten für KI-Systeme. Ab dem 2. August 2026 gilt: Wer Inhalte mithilfe von KI erzeugt oder maßgeblich durch KI erzeugen lässt, muss diese Inhalte für Empfänger erkennbar kennzeichnen. Das betrifft Texte, Bilder, Audio und Video.

Konkret für Content-Teams heißt das:

- Blogbeiträge, die zu einem wesentlichen Teil von KI-Systemen generiert wurden, müssen als KI-generiert gekennzeichnet werden.

- Die Kennzeichnung muss „wirksam, eindeutig und sichtbar" sein, also kein Kleingedrucktes im Footer.

- Auch Bilder, die per KI erstellt wurden (z. B. Midjourney, DALL-E), fallen darunter.

- Die Pflicht gilt für Anbieter und Nutzer von KI-Systemen gleichermaßen.

Die Bundesnetzagentur und das BfDI testen aktuell im Rahmen nationaler KI-Reallabore, wie diese Anforderungen für KMU umsetzbar sind (e-health-com, 2025). Das Projekt gilt als Erfolg, aber konkrete Umsetzungsleitfäden für Content-Teams fehlen noch. Sprich: Du kannst nicht auf offizielle Handreichungen warten. Du musst jetzt handeln.

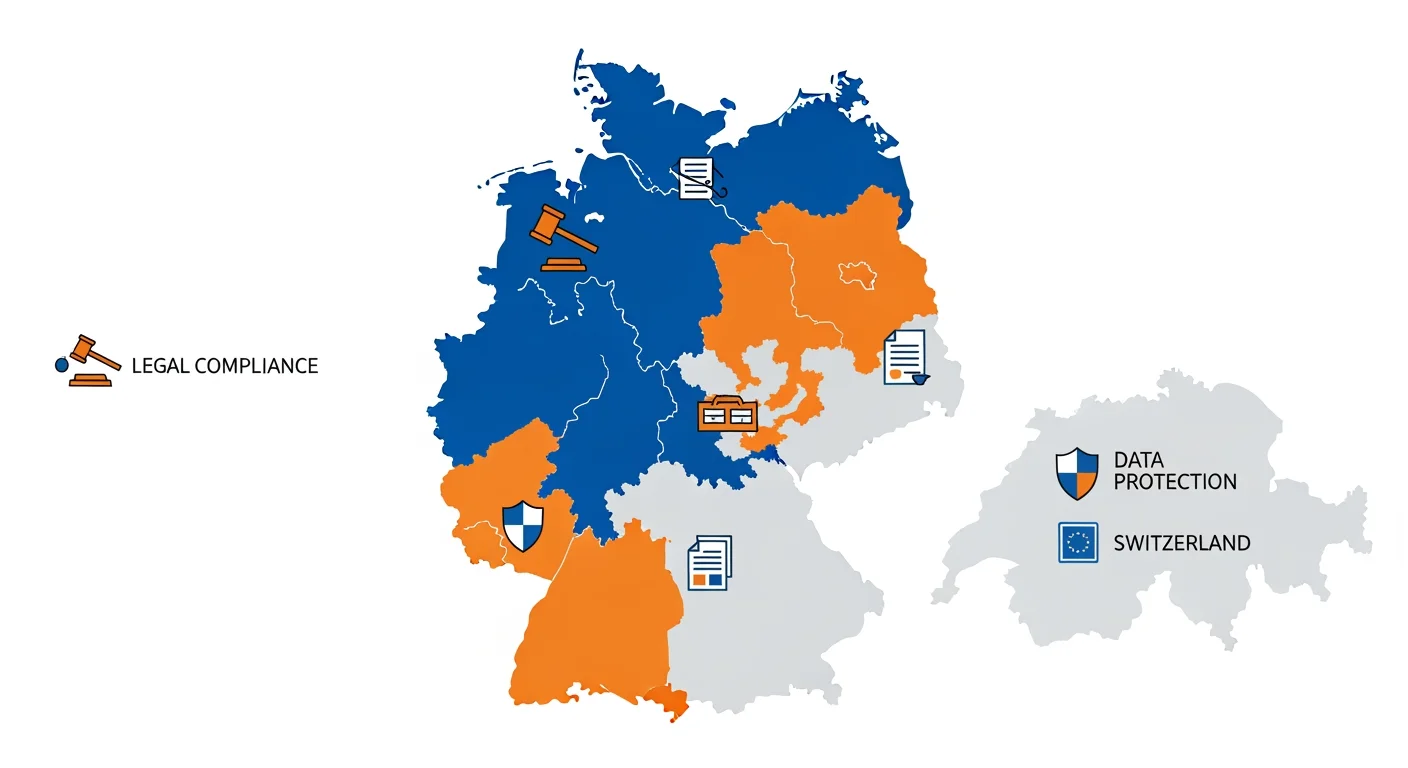

Wichtig noch für den DACH-Vergleich:

| Land | Rechtsgrundlage | Kennzeichnungspflicht ab | Zuständige Behörde | Besonderheit |

|---|---|---|---|---|

| Deutschland | EU AI Act Art. 50 + UrhG | August 2026 | Bundesnetzagentur, BfDI | KI-Reallabore aktiv getestet |

| Österreich | EU AI Act Art. 50 | August 2026 | Rundfunk & Telekom Regulierungs-GmbH (RTR) | Nationale Umsetzungsgesetze noch in Abstimmung |

| Schweiz | Kein EU AI Act (Drittland) | Freiwillig / bilateral | EDÖB (Datenschutz) | Eigene KI-Strategie des Bundesrats, kein Art. 50 direkt |

Kleiner Hinweis für Teams mit CH-Kunden: Die Schweiz ist kein EU-Mitglied, also gilt Art. 50 dort nicht direkt. Aber wenn du aus der EU heraus Content für Schweizer Märkte produzierst oder umgekehrt, greift das Marktortprinzip. Das ist eine Grauzone, die du mit einem Anwalt klären solltest.

Die „Human-in-the-Loop"-Ausnahme: Wann entfällt die Kennzeichnungspflicht?

Jetzt wird es interessant. Denn Art. 50 enthält eine wichtige Ausnahme, die in der bisherigen Berichterstattung kaum erwähnt wird.

Die Kennzeichnungspflicht entfällt, wenn ein Mensch den KI-Output substanziell überprüft, verändert und verantwortet. Das nennt sich „Human-in-the-Loop" (HITL). Die genaue Schwelle ist noch nicht abschließend definiert, aber der Grundgedanke ist klar: Wenn KI nur ein Werkzeug ist und der Mensch die inhaltliche Verantwortung trägt und erkennbar gestalterisch tätig war, greift die Kennzeichnungspflicht nicht automatisch.

Was zählt als ausreichende menschliche Beteiligung? Aus meiner Erfahrung mit der Implementierung von KI-Workflows bei Simplifiers.ai würde ich folgende Kriterien anlegen:

- Mindestens 40–50 % des finalen Texts wurden menschlich geschrieben oder grundlegend umstrukturiert.

- Alle Fakten wurden manuell überprüft und belegt.

- Stilistische Entscheidungen, Argumentation und Perspektive stammen erkennbar vom menschlichen Autor.

- Der Redakteur ist namentlich als Autor ausgewiesen und trägt inhaltliche Verantwortung.

Ich denke, die 50-%-Regel ist ein guter Daumenmaßstab für die Praxis, bis klarere Richtwerte durch Rechtsprechung oder Behördenleitlinien folgen. Aber vorsichtig: Das ist keine Rechtsberatung, das ist meine operative Einschätzung. Für verbindliche Aussagen brauchst du einen Anwalt.

Was most guides miss ist hier tatsächlich die Workflow-Frage. Es geht nicht um einzelne Tools oder deren Features, es geht darum, wie du HITL systematisch in deinen Redaktionsprozess integrierst. Wer das als nachträglichen Compliance-Schritt behandelt, verliert. Wer es als Kernbestandteil des Workflows aufbaut, gewinnt.

DSGVO und KI-Content: Was musst du bei der Texterstellung beachten?

Die DSGVO ist in der KI-Content-Debatte oft der blinde Fleck. Dabei ist sie hochrelevant. Immer dann, wenn du personenbezogene Daten in ein KI-System eingibst, greift die DSGVO. Und das passiert schneller, als du denkst.

Typische Risikosituationen im Content-Alltag:

- Du promptest ChatGPT mit dem Namen und den Aussagen eines Kunden für eine Case Study.

- Du gibst Kundendaten in ein KI-Tool ein, um personalisierte Newsletter zu erstellen.

- Du nutzt ein KI-Tool, dessen Anbieter Nutzerdaten für das Training verwendet (ohne Opt-out).

76,5 % der Autor:innen haben laut der Börsenblatt-Umfrage 2025 Bedenken bezüglich des Missbrauchs von Trainingsdaten (Börsenblatt, 2025). Das ist keine Paranoia. Das ist ein echtes Risiko.

Was du konkret tun musst:

- Auftragsverarbeitungsvertrag (AVV): Schließe einen AVV mit jedem KI-Tool-Anbieter, der personenbezogene Daten verarbeitet. OpenAI, Anthropic, Google bieten das an, aber du musst es aktiv einrichten.

- Datensparsamkeit: Kein Eingeben von Klarnamen, Kundendaten oder anderen personenbezogenen Informationen in KI-Prompts ohne Rechtsgrundlage.

- Serverstandort prüfen: Daten, die in die USA übertragen werden, unterliegen dem Data Privacy Framework. Das gilt derzeit noch, aber die Lage ist politisch fragil.

- Art. 9 DSGVO besonders beachten: Sensible Daten (Gesundheit, Religion, politische Meinung) dürfen nicht ohne explizite Einwilligung in KI-Systeme eingegeben werden.

Mein Tipp aus der Praxis: Pseudonymisiere alle Eingaben. Ersetze Klarnamen durch Platzhalter, bevor du sie in ein KI-Tool gibst. Das kostet 30 Sekunden und schützt dich vor ernsthaften DSGVO-Verstößen.

Compliance-Checkliste: 10 Punkte für rechtssicheren KI-Content

Kein Theorieexkurs mehr, jetzt wird es praktisch. Hier sind die 10 Punkte, die du in deinem Team umsetzen musst, bevor der August 2026 kommt:

- KI-Tool-Inventar erstellen: Welche KI-Tools nutzt dein Team? Liste alle auf und prüfe, ob AVVs vorhanden sind.

- Urheberrechtsstatus klären: Definiere intern, ab welchem Bearbeitungsgrad ihr einen Text als urheberrechtlich geschützt betrachtet.

- Kennzeichnungsstandard festlegen: Entscheide jetzt, wie ihr KI-Content kennzeichnen werdet (z. B. Hinweis am Artikelanfang oder -ende).

- HITL-Prozess dokumentieren: Halte schriftlich fest, welche Schritte menschliche Redakteure bei KI-generierten Texten durchlaufen. Das ist dein Compliance-Nachweis.

- AVVs abschließen: Mit allen KI-Tool-Anbietern, die personenbezogene Daten verarbeiten könnten.

- Prompt-Richtlinien einführen: Verbiete das Eingeben personenbezogener Daten in KI-Prompts ohne definierte Ausnahmen.

- Faktencheck-Pflicht etablieren: Jeder KI-generierte Text muss vor Veröffentlichung manuell auf Faktentreue geprüft werden.

- Autorenverantwortung klären: Wer zeichnet für welchen Text verantwortlich? Das muss im Impressum und/oder Byline sichtbar sein.

- Mitarbeiter schulen: Alle, die KI-Tools nutzen, müssen die Grundlagen von Kennzeichnungspflicht und DSGVO kennen. Kein Nice-to-have.

- Interne KI-Content-Richtlinie verabschieden: Schriftlich, verbindlich, mit Datum. Mehr dazu im nächsten Abschnitt.

KI-Content-Richtlinie für Unternehmen: Muster und Template

Eine interne KI-Content-Richtlinie ist dein wichtigstes Compliance-Dokument. Sie schützt dich gegenüber Behörden, klärt intern die Verantwortlichkeiten und gibt deinem Team Orientierung. Hier ist ein schlankes Muster-Template, das du direkt adaptieren kannst:

KI-Content-Richtlinie [Unternehmensname] – Stand: [Datum]

1. Geltungsbereich: Diese Richtlinie gilt für alle Mitarbeiter:innen, die KI-Tools zur Erstellung, Bearbeitung oder Recherche von Inhalten nutzen.

2. Zulässige KI-Tools: [Liste der freigegebenen Tools einfügen, z. B. ChatGPT Enterprise mit AVV, Notion AI mit AVV]

3. Kennzeichnungspflicht: Texte, die zu mehr als 30 % durch KI generiert wurden und nicht substanziell menschlich überarbeitet worden sind, werden mit folgendem Hinweis versehen: „Dieser Artikel wurde mit Unterstützung von KI-Tools erstellt und redaktionell überprüft."

4. Urheberrecht: Rein KI-generierte Texte werden intern nicht als urheberrechtlich geschützt behandelt. Texte, die substanziell menschlich bearbeitet wurden, gelten als Werke des bearbeitenden Autors/der bearbeitenden Autorin.

5. Datenschutz: Die Eingabe personenbezogener Daten in KI-Systeme ohne Rechtsgrundlage und AVV ist untersagt. Sensible Daten gemäß Art. 9 DSGVO dürfen nicht in KI-Prompts verwendet werden.

6. Human-in-the-Loop-Pflicht: Vor Veröffentlichung eines KI-gestützten Texts muss mindestens eine redaktionell verantwortliche Person den Text inhaltlich geprüft, bearbeitet und freigegeben haben. Dieser Schritt wird im CMS dokumentiert.

7. Verstöße: Verstöße gegen diese Richtlinie werden als arbeitsrechtlich relevante Pflichtverletzung behandelt.

Das ist ein Minimaltemplate. Je nach Unternehmensgröße und Content-Volumen solltest du es erweitern, z. B. um Eskalationspfade oder spezifische Tool-Protokolle. Aber besser ein schlankes Dokument jetzt als ein perfektes Dokument nie.

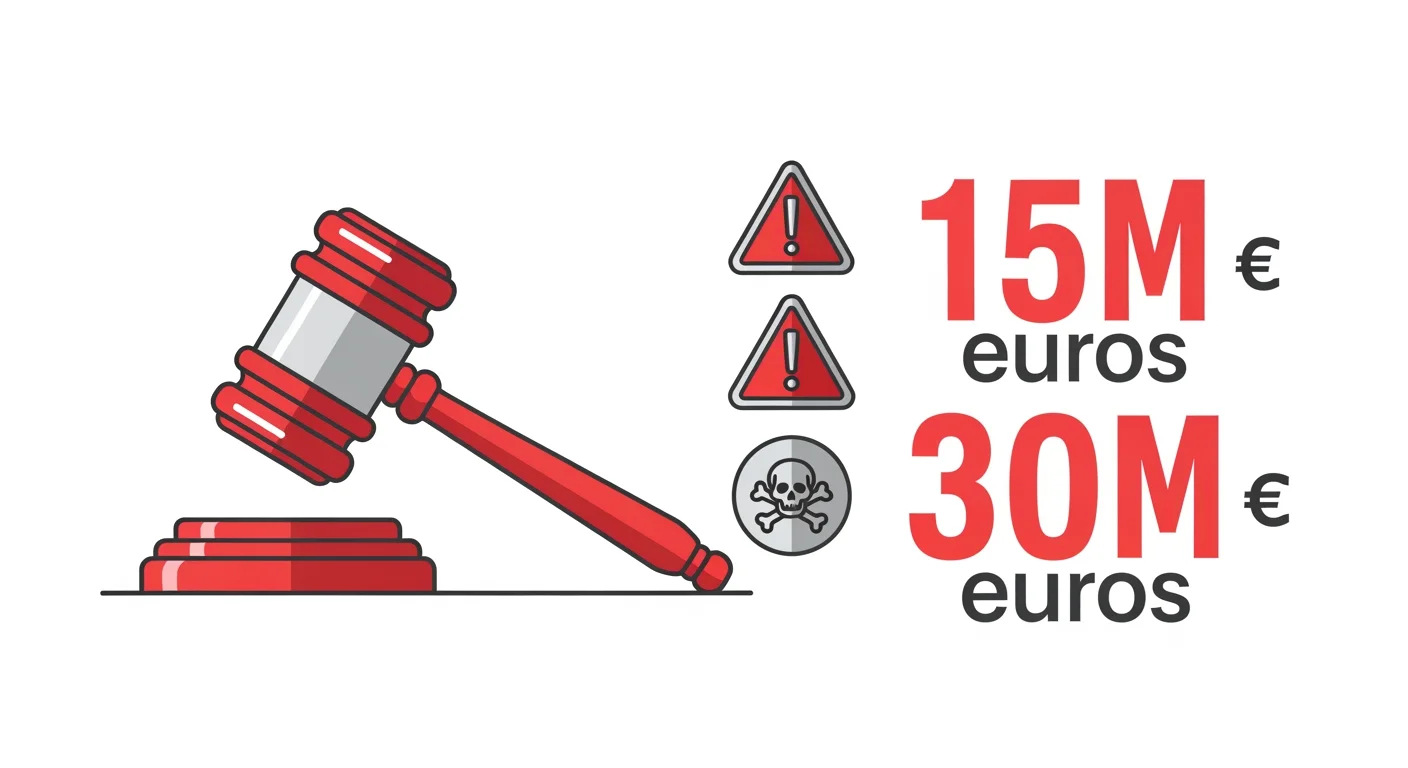

Was droht bei Verstößen? Bußgelder und Haftungsrisiken

Okay, hier kommen die Zahlen, die Aufmerksamkeit erzeugen sollten.

Der EU AI Act sieht folgende Bußgelder vor:

- Verstöße gegen Art. 50 (Kennzeichnungspflicht): Bis zu 15 Mio. Euro oder 3 % des weltweiten Jahresumsatzes, je nachdem, was höher ist.

- Schwerwiegendere Verstöße (Hochrisiko-KI): Bis zu 30 Mio. Euro oder 6 % des Jahresumsatzes.

- Falsche Angaben gegenüber Behörden: Bis zu 7,5 Mio. Euro oder 1 % des Jahresumsatzes.

Dazu kommen DSGVO-Bußgelder: Bis zu 20 Mio. Euro oder 4 % des weltweiten Jahresumsatzes bei schwerwiegenden Verstößen. Und zivilrechtliche Haftung für Urheberrechtsverletzungen, die durch fehlerhaften Umgang mit KI-generierten Texten entstehen.

Aber ehrlich gesagt, die Bußgelder sind nicht das eigentliche Risiko für die meisten Content-Teams. Das eigentliche Risiko ist Reputationsverlust. 77 % der deutschen Autor:innen haben ernsthafte Qualitätsbedenken gegenüber KI-Texten (Börsenblatt, 2025). Wenn deine Leser herausfinden, dass du unkennzeichneten KI-Content veröffentlicht hast, verlierst du Vertrauen. Und wie Retresco treffend formuliert: Einmal verlorene Leser kommen nicht zurück.

Risiken und typische Fehler, die du kennen solltest

Ich war anfangs skeptisch, ob ein eigener Risikoabschnitt nötig ist. Aber aus meiner Arbeit mit über 200 Startups bei AI NATION weiß ich: Die meisten Fehler passieren nicht aus Böswilligkeit, sondern aus Unwissenheit. Also hier, die häufigsten Fallen:

Fehler 1: AVV vergessen. Du nutzt ChatGPT, gibst Kundendaten ein, kein AVV. Klassiker. Kostet potenziell viel.

Fehler 2: Kennzeichnung als Fußnote verstecken. „Eindeutig und sichtbar" bedeutet wirklich sichtbar. Ein Hinweis in der Größe 8pt im Footer zählt nicht.

Fehler 3: HITL nur behaupten, nicht dokumentieren. Wenn die Behörde fragt, wie der menschliche Überprüfungsprozess aussieht, und du keine Aufzeichnungen hast, hast du ein Problem. Dokumentier den Prozess im CMS.

Fehler 4: Schweizer Rechtsrahmen mit EU-Rahmen gleichsetzen. Die Schweiz hat eigene Regeln. DACH ist nicht gleich EU.

Fehler 5: KI-Content ohne Faktencheck veröffentlichen. KI halluziniert. 77 % der Autor:innen wissen das. Trotzdem passiert es täglich. Manueller Faktencheck ist Pflicht, kein Optional.

Und noch ein ehrlicher Hinweis: Dieser Ansatz, also die Kombination aus HITL, AVV und Kennzeichnung, funktioniert am besten für Teams mit klaren Prozessen und Verantwortlichkeiten. Kleinere Teams ohne dedizierte Redaktionsstruktur haben es schwerer, das konsistent umzusetzen. Das ist keine Entschuldigung, das weg zu lassen, aber ein Grund, die Richtlinie schlank zu halten und schrittweise aufzubauen.

Häufig gestellte Fragen (FAQ)

Was macht ein KI-Redakteur?

Ein KI-Redakteur nutzt KI-Tools primär für Recherche (74,3 %), Ideenfindung (58,5 %), Korrektorat (58,5 %) und Lektorat (48,4 %). Nur 23,9 % setzen KI zur eigentlichen Textgenerierung ein (Börsenblatt, 2025). Der Fokus liegt auf dem Mensch-KI-Hybrid: KI als Werkzeug, Mensch als inhaltliche Instanz. Der KI-Redakteur trägt weiterhin die volle redaktionelle Verantwortung und stellt sicher, dass Kennzeichnungspflichten nach EU AI Act Art. 50 eingehalten werden.

Welche 4 Arten von KI gibt es?

Im Content-Kontext relevant sind: 1. Generative KI (erzeugt Text, Bilder, Audio, z. B. ChatGPT, Midjourney), 2. Diskriminative KI (klassifiziert und filtert, z. B. Spam-Filter, Content-Moderation), 3. Reaktive KI (reagiert auf Inputs ohne Lernfähigkeit, z. B. regelbasierte Chatbots), 4. KI mit begrenztem Gedächtnis (kontextbasiert, z. B. GPT-4 mit Konversationsgedächtnis). Für Content-Teams dominiert generative KI, die auch unter die Kennzeichnungspflicht des EU AI Acts fällt.

Darf man KI-Texte veröffentlichen?

Ja. Es gibt kein generelles Verbot für die Veröffentlichung von KI-Texten. Ab August 2026 musst du jedoch KI-generierten Content nach EU AI Act Art. 50 kennzeichnen, es sei denn, du kannst eine substanzielle menschliche Überarbeitung im Sinne von „Human-in-the-Loop" nachweisen. Urheberrechtlich gilt: Rein KI-generierte Texte ohne menschliche Schöpfungshöhe sind in Deutschland nicht urheberrechtlich geschützt.

Wie kann ich mit KI sicher kommunizieren?

Nutze präzise Prompts mit Kontext, Aufgabe und gewünschtem Format. Gib niemals personenbezogene Daten ohne AVV und Rechtsgrundlage ein. Pseudonymisiere Eingaben, wo möglich. Prüfe alle KI-Ausgaben manuell auf Faktentreue, denn KI halluziniert. Für DSGVO-konforme Nutzung: Schließe AVVs mit allen Tool-Anbietern, die potentiell Personendaten verarbeiten, und dokumentiere deine Prozesse.