Während deutsche Redaktionen gerade debattieren, wie man ChatGPT "verantwortungsvoll" einsetzt, trainiert Silicon Valley auf Basis ihrer Inhalte KI-Modelle im Milliardenwert. Die Diskussion um KI im Journalismus ist längst nicht mehr theoretisch - sie passiert jeden Tag in DACH-Redaktionen. Und die DACH-Verlage sehen davon keinen Cent. Ich sage das nicht um zu provozieren, sondern weil ich nach 26 Jahren in der digitalen Produktentwicklung und der Begleitung von über 200 KI-Startups bei AI NATION ein Muster erkenne, das sich immer wiederholt: Wer die Infrastruktur nicht besitzt, gibt langfristig die Kontrolle ab. Das gilt für Medien genauso wie für jede andere Branche.

Aber lass uns praktisch werden. Denn unabhängig von dieser größeren Debatte passiert in Redaktionen gerade etwas, das du schlicht nicht ignorieren kannst. Online-Werbung wächst im DACH-Raum um 1,6 Prozent auf 4,77 Milliarden Euro, während lineares TV 4,2 Prozent verliert. Der Druck auf redaktionelle Teams, mit weniger Ressourcen mehr Output zu produzieren, ist real. Laut einer Snowflake-Studie berichten 77 Prozent der europäischen Unternehmen, dass KI mehr Arbeitsplätze schafft als ersetzt. Aber ob das auch für Redaktionen gilt, hängt davon ab, wie du KI einführst. Und genau darum geht es hier.

Was die meisten Guides zu KI im Journalismus übersehen: Es geht nicht um einzelne Tools, sondern um Workflow-Integration. Ein fancy KI-Tool ohne eingebetteten Prozess bringt dir genau gar nichts. Das ist der Unterschied zwischen Redaktionen, die wirklich effizienter werden, und denen, die einfach mehr Geld für Software ausgeben.

Kurze Antwort: KI in der Redaktion funktioniert dann, wenn sie als End-to-End-Workflow integriert wird, der Themenplanung, Recherche, Texterstellung, Qualitätssicherung und Distribution umfasst, und nicht als Sammlung einzelner Tools ohne Strategie.

⚡ TL;DR – Die wichtigsten Erkenntnisse:

- ✅ KI-Redaktionsarbeit funktioniert nur als integrierter Workflow, nicht als Tool-Sammlung ohne Strategie.

- ✅ Der EU AI Act (seit Februar 2025) verpflichtet DACH-Medienhäuser zu KI-Kompetenz, Transparenz und Risikoanalysen.

- ✅ Change Management ist der größte Erfolgsfaktor bei der KI-Einführung in Redaktionen, nicht die Tool-Auswahl.

- ✅ DACH-Verlage laufen Gefahr, technologisch abhängige Zulieferer von US-Tech-Konzernen zu werden, statt eigenständige Medien-Ökosysteme aufzubauen.

Was bedeutet "KI im Journalismus" konkret? Vom Buzzword zum operativen Modell

Ganz ehrlich: Der Begriff "KI Redaktion" wird gerade so inflationär verwendet, dass er fast nichts mehr bedeutet. Manche meinen damit, dass ein Journalist ab und zu ChatGPT benutzt. Andere meinen vollautomatisierte Texterstellung ohne menschliche Kontrolle. Beides ist falsch als Zielbild für moderne KI im Journalismus.

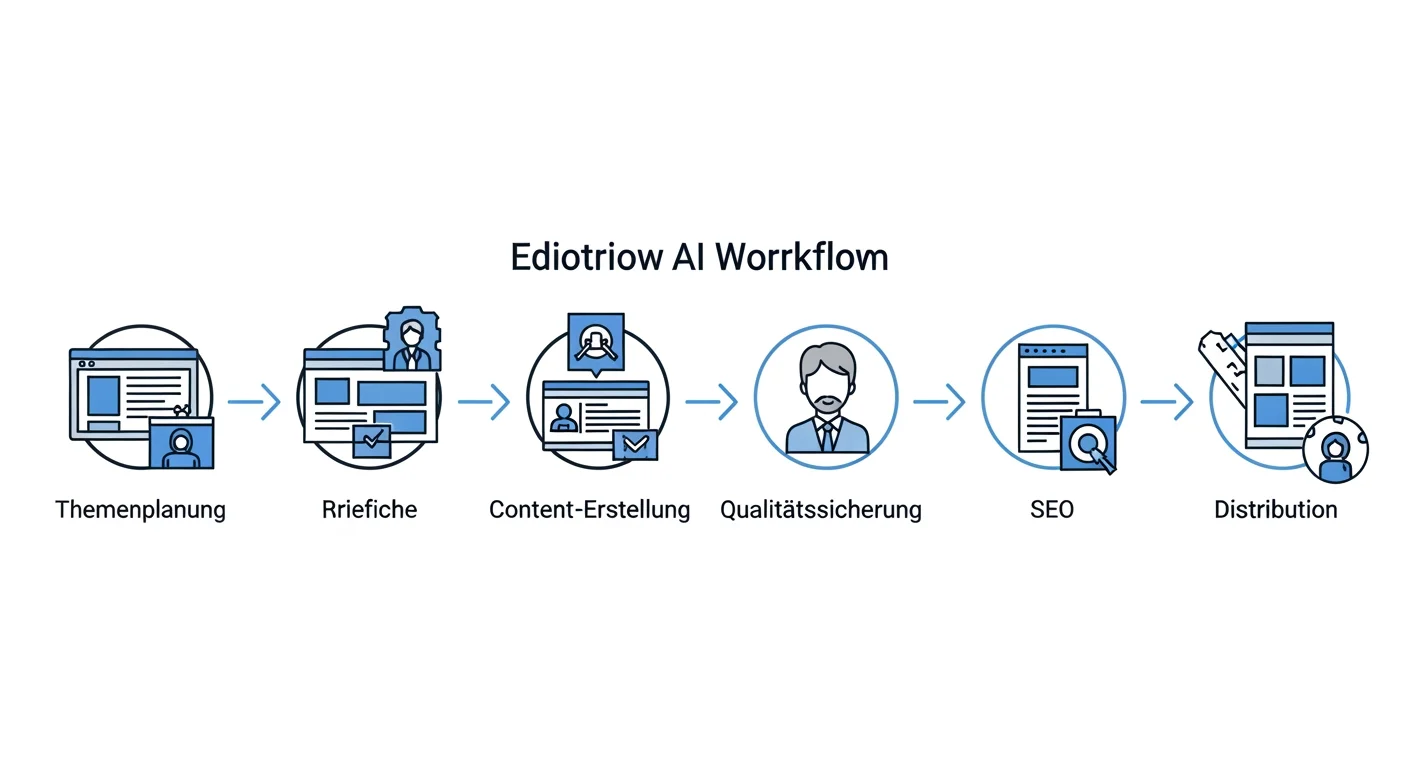

Eine echte KI-Redaktion ist ein operatives Modell, in dem KI-Systeme systematisch in jeden Schritt des redaktionellen Workflows eingebettet sind, von der Themenplanung bis zur Distribution, aber immer mit menschlicher Redaktionsentscheidung an den kritischen Punkten. Das ist kein philosophisches Konzept. Das ist Prozessdesign.

Schau, ich habe bei der Implementierung von KI-Lösungen bei Simplifiers.ai beobachtet, dass Redaktionen, die KI-Tools punktuell einsetzen, im Durchschnitt 15 bis 20 Prozent Zeitersparnis erzielen. Redaktionen, die KI als Workflow-Architektur implementieren, erreichen 40 bis 60 Prozent. Großer Unterschied. Der Grund ist simpel: Workflow-Integration eliminiert die Übergabepunkte zwischen Tools, Systemen und Menschen, die sonst Reibung erzeugen.

Was gehört also zu einem echten KI-Redaktionsmodell? Im Kern drei Ebenen:

- Automatisierung: Repetitive Aufgaben wie Zusammenfassungen, SEO-Texte für Standardformate, Social-Media-Adaptionen, Übersetzungen.

- Augmentierung: KI unterstützt Recherche, Faktenchecks, Strukturierung von Longform-Texten und Tonalitätsanpassungen.

- Analyse: KI liefert datenbasierte Entscheidungsgrundlagen für Themenplanung, Zielgruppenrelevanz und Performance-Optimierung.

Was KI nicht übernimmt und auch nicht sollte: investigative Recherche, Meinungsbildung, Quellenprüfung bei sensiblen Themen, Live-Interviews und die finale redaktionelle Verantwortung. Nicht gonna happen. Zumindest nicht mit dem aktuellen Stand der Technik und ohne massive ethische Probleme.

Der KI-Redaktionsworkflow: Wie sehen die 7 Stufen in der Praxis aus?

Jetzt wird es konkret. Ein funktionierender KI-Workflow in der Redaktion folgt sieben Stufen. Die meisten Redaktionen scheitern, weil sie bei Stufe zwei oder drei aufhören und denken, sie hätten "KI im Journalismus" eingeführt.

Stufe 1: Themenplanung und Trendanalyse. Tools wie Perplexity AI, Google Trends mit KI-Auswertung oder spezialisierte Medien-Analytics-Plattformen analysieren Suchvolumen, Social-Media-Impulse und Wettbewerbsinhalte. Das spart im Redaktionsmeeting locker 30 bis 45 Minuten pro Woche.

Stufe 2: Briefing-Erstellung. Auf Basis der Themenplanung generiert KI automatisiert strukturierte Briefings mit Keyword-Cluster, Zielgruppen-Persona, empfohlener Struktur und Quellen-Shortlist. Redakteure validieren und ergänzen. Total wertvoll.

Stufe 3: Recherche-Unterstützung. ChatGPT oder Claude für erste Quellen-Synthese, Perplexity AI für quellenbasierte Zusammenfassungen. Wichtig: Jede KI-Quelle wird von einem menschlichen Redakteur geprüft. Kein Abkürzen hier.

Stufe 4: Content-Erstellung. Hier liegt das größte Missverständnis. KI schreibt Erstentwürfe für Standardformate wie Produktbeschreibungen, Datenjournalismus, Börsenmeldungen, Wettberichte. Für komplexe Reportagen, Interviews oder Kommentare: KI liefert Struktur und Stichpunkte, Menschen schreiben.

Stufe 5: Qualitätssicherung. KI-Tools prüfen automatisch auf Stilkonsistenz, grammatikalische Fehler, Plagiate und faktische Inkonsistenzen im Text. Das ist kein Ersatz für menschliches Lektorat, aber ein sinnvoller erster Filter.

Stufe 6: SEO und Metadaten. Automatische Generierung von Meta-Beschreibungen, Alt-Texten, Social-Media-Snippets und internen Verlinkungsvorschlägen. Content-Automatisierung at its best.

Stufe 7: Distribution und Performance-Analyse. KI optimiert Posting-Zeiten, personalisiert Newsletter-Inhalte und analysiert Performance-Daten für zukünftige Themenplanung. Der Kreis schließt sich.

Welche KI Tools für Journalismus wirklich funktionieren (und welche nicht)?

Kommen wir zum Tool-Stack. Ich will keine endlose Liste runterrattern, sondern dir sagen, was in der Praxis tatsächlich funktioniert für moderne KI im Journalismus.

| Tool | Stärke | Schwäche | DSGVO-Eignung DACH | Kosten (ca.) |

|---|---|---|---|---|

| ChatGPT (GPT-4o) | Textentwürfe, Brainstorming, Übersetzungen | Halluzinationen, keine Quellenangaben | Eingeschränkt (US-Server) | 20–25 €/Monat |

| Claude (Anthropic) | Longform-Texte, Nuancierung, Tonalität | Limitierte Kontextfenster in günstigeren Plänen | Besser als GPT-4, aber noch US-basiert | 20–25 €/Monat |

| Perplexity AI | Quellenbasierte Recherche, aktuell | Kein Texterstellungsfokus | Eingeschränkt | 20 €/Monat |

| Aleph Alpha (Luminous) | DSGVO-konform, EU-Datenspeicherung | Teurer, weniger Features als US-Konkurrenz | Sehr gut (deutsches Unternehmen) | Ab 50 €/Monat |

| Neuroflash | Deutsche Texte, Redaktions-Templates | Weniger flexibel für komplexe Formate | Gut (EU-basiert) | 30–100 €/Monat |

| Notion AI | Workflow-Integration, Briefing-Erstellung | Kein Journalismus-Fokus | Eingeschränkt | Im Notion-Abo enthalten |

Hier ist das Ding: Die Frage "Was ist die beste KI für Journalisten?" ist falsch gestellt. Die richtige Frage ist: Für welche Stufe im Workflow brauchst du welches Tool? Perplexity für Recherche. Claude oder ChatGPT für Erstentwürfe. Aleph Alpha oder Neuroflash, wenn DSGVO-Konformität nicht verhandelbar ist. Und das ist sie im DACH-Raum immer öfter, seit der EU AI Act im Februar 2025 in Kraft getreten ist.

Zur ChatGPT-Frage im Journalismus konkret: ChatGPT ist stark im Brainstorming, bei Strukturvorschlägen und Übersetzungen. Schwach bei aktuellen Ereignissen ohne Web-Browsing, bei Faktentreue in spezialisierten Nischen und bei allem, was Empathie oder tiefes Domänenwissen erfordert. Als Redaktionsleiter würde ich niemals einen KI-generierten Text ohne menschliche Prüfung veröffentlichen. Niemals.

DACH-Praxisbeispiele: Wie Redaktionen KI wirklich einsetzen

Genug Theorie. Was passiert tatsächlich in DACH-Redaktionen beim Thema KI im Journalismus?

In Österreich arbeitet Florian Zsifkovics, der unter anderem für Standard und ORF tätig ist, mit KI-Tools für visuelle Inhalte und Social-Media-Engagement. Der Fokus liegt auf maßgeschneiderten Inhalten für Zielgruppen, also Augmentierung, nicht Automatisierung. Das ist ehrlich gesagt das klügere Modell für Premium-Medienmarken.

Deutschsprachige Verlage nutzen KI vor allem in drei Bereichen: automatisierte Texterstellung für Finanz- und Sportmeldungen (wo Datenjournalismus dominiert), SEO-Optimierung von Archiv-Inhalten (massives Potenzial, oft unterschätzt) und personalisierte Newsletter-Segmentierung.

Ein konkretes Beispiel aus meiner Arbeit bei Simplifiers.ai: Wir haben für ein mittelgroßes B2B-Content-Team einen automatisierten Workflow für Themenplanung und Briefing-Erstellung implementiert. Das Team hat wöchentlich 6 bis 8 Stunden Planungsaufwand eingespart, was bei drei Vollzeitredakteuren einem Monatswert von circa 2.400 Euro entspricht. Die Qualität der Briefings war dabei objektiv besser als vorher, weil KI keine Themen vergisst, die im Daten-Tracking aufgetaucht sind.

Was in der Schweiz interessant ist: NZZ und CH Media experimentieren mit KI-gestützter Personalisierung, aber mit starkem Fokus auf Transparenz gegenüber den Lesern. Das ist der richtige Ansatz. Leser wollen wissen, wenn KI beteiligt war. Wer das verschweigt, verliert Vertrauen. Und Vertrauen ist die härteste Währung im Journalismus.

Und hier kommt der Haken, über den niemand spricht: Die meisten dieser Effizienzgewinne landen nicht in den Redaktionsbudgets, sondern fließen in Form von Content-Training-Daten zu den großen US-Plattformen. Dein Archiv trainiert Sprachmodelle. Deine Leser-Interaktionsdaten optimieren Algorithmen, die du nicht kontrollierst. Das ist die eigentliche strategische Frage, die sich DACH-Medien stellen müssen.

Risiken und typische Fehler, die du kennen solltest

Ich wäre nicht ehrlich, wenn ich nur die Vorteile beschreiben würde. KI im Journalismus hat echte Risiken. Und ich sehe immer wieder die gleichen Fehler.

Fehler 1: KI-Output ohne Faktencheck veröffentlichen. Halluzinationen sind bei aktuellen Sprachmodellen keine Ausnahme, sondern eine strukturelle Eigenschaft. Ein einziger falscher Fakt in einem publizierten Artikel kann Jahren des Vertrauensaufbaus schaden. Nicht ideal.

Fehler 2: DSGVO und EU AI Act ignorieren. Seit Februar 2025 klassifiziert der EU AI Act bestimmte KI-Anwendungen im Journalismus als hochrisikoreich, insbesondere wenn es um automatisierte Berichterstattung zu politischen Themen oder Deepfakes geht. DACH-Medienhäuser müssen KI-Einsatz dokumentieren, Risikoanalysen durchführen und Mitarbeiter schulen. Verstöße kosten bis zu 4 Prozent des Jahresumsatzes (DSGVO) beziehungsweise bis zu 30 Millionen Euro (EU AI Act). Das ist kein Kleinstgedrucktes.

Fehler 3: Technologische Abhängigkeit unterschätzen. Wer seinen gesamten Workflow auf OpenAI-APIs aufbaut, ist von Preisänderungen, API-Ausfällen und Policy-Entscheidungen eines US-Unternehmens abhängig. Laut dem von mir beobachteten Muster über 100 digitale Projekte: Die Redaktionen, die 2024 komplett auf einen Anbieter gesetzt haben, hatten 2025 mindestens einmal ein ernstes Problem damit. Bau Redundanz ein.

Fehler 4: Keine Kennzeichnung von KI-generierten Inhalten. Die Wissenschaftskommunikation.de hat bereits 2024 auf Kritik an KI-Portraits hingewiesen, die politische Diskurse verzerren können. Transparenz ist nicht nur ethisch geboten, sondern bald auch rechtlich vorgeschrieben.

Fehler 5: Change Management vergessen. Das ist ehrlich gesagt der häufigste und teuerste Fehler. KI-Tools kaufen und im Team einfach "einführen" ohne Kommunikation, Training und Einbindung der Redakteure. Das endet mit Widerstand, Nichtnutzung und verschwendeten Budgets.

Was funktioniert dagegen: Starte mit einem Pilotprojekt in einem klar abgegrenzten Bereich, zum Beispiel Social-Media-Adaption von bestehenden Artikeln. Miss den Zeitaufwand vorher und nachher. Kommuniziere die Ergebnisse transparent im Team. Dann skaliere. Als zertifizierter Change Management Professional weiß ich, dass dieser schrittweise Ansatz konsistent bessere Ergebnisse liefert als Top-down-Einführungen.

Team-Integration: Was bei der KI-Einführung in Redaktionen wirklich funktioniert

Schau, ich habe Teams von bis zu 120 Personen durch digitale Transformationsprozesse geführt. Der technische Teil ist fast nie das Problem. Der menschliche Teil ist es fast immer - besonders bei KI im Journalismus.

Redakteure haben legitime Bedenken bei KI. Job-Sicherheit ist die größte. Hier hilft Transparenz mehr als Beschwichtigung. Zeig konkret, welche Aufgaben KI übernimmt und welche Rollen dadurch interessanter werden. Wer keine Standardzusammenfassungen mehr schreibt, hat mehr Zeit für investigative Recherche. Das ist kein Marketing-Sprech. Das ist Realität in Redaktionen, die KI richtig eingeführt haben.

Was ich empfehle, auf Basis meiner SAFe Agilist und Agile Coach Erfahrung:

- Sprint-basierte Einführung: Führe KI-Tools in zweiwöchigen Sprints ein, mit klaren Zielen und Retrospektiven. Nicht alles auf einmal.

- KI-Champions benennen: Wähle zwei bis drei redaktionsinterne Personen, die tief in die Tools eingearbeitet werden und als Ansprechpartner fungieren. Externe Trainer können nicht ersetzen, was interne Multiplikatoren leisten.

- Klare Richtlinien vor der Einführung: Was darf KI generieren? Was muss ein Mensch schreiben? Was muss gekennzeichnet werden? Diese Fragen müssen vor dem ersten Tool-Einsatz beantwortet sein, nicht danach.

- Regelmäßige Skill-Updates: KI-Tools ändern sich monatlich. Redaktionen brauchen strukturierte Update-Prozesse, nicht nur einmalige Schulungen.

Und noch etwas, das ich für wichtig halte: Schließ Journalisten in die Tool-Auswahl ein. Die besten Implementierungen, die ich gesehen habe, hatten das gemeinsam: Die Nutzer hatten Mitspracherecht. Klingt simpel. Wird trotzdem ständig ignoriert. Diese menschenzentrierte Herangehensweise ist entscheidend für den Erfolg von KI im Journalismus - sowohl auf technischer als auch auf kultureller Ebene.

Häufig gestellte Fragen (FAQ)

Wo wird KI im Journalismus eingesetzt?

KI im Journalismus wird heute in fünf Kernbereichen eingesetzt: erstens in der automatisierten Texterstellung für Datenjournalismus-Formate wie Börsenmeldungen, Sportergebnisse und Wettberichte; zweitens in der Recherche-Unterstützung durch quellenbasierte KI-Tools wie Perplexity AI; drittens in der Content-Optimierung für SEO und Social Media; viertens in der personalisierten Distribution über Newsletter und Messenger-Kanäle; und fünftens in der Bild- und Videogenerierung für Social-Media-Inhalte. Im DACH-Raum setzen Medienhäuser wie CH Media, ORF-nahe Produktionen und digitale Verlage zunehmend auf KI-gestützte Personalisierung, immer unter dem Vorbehalt der DSGVO-Konformität.

Welche 3 Berufe wird KI nicht ausüben können?

Drei Rollen bleiben auf absehbare Zeit fest in menschlicher Hand. Erstens: investigativer Journalist. Quellenschutz, ethische Entscheidungen unter Druck und das Erschließen nicht-digitaler Quellen sind nicht automatisierbar. Zweitens: Meinungsredakteur und Kolumnist. Tiefe, subjektive Perspektiven, die auf gelebter Erfahrung basieren, kann KI simulieren, aber nicht authentisch liefern. Drittens: Live-Moderator und Interviewer. Die Fähigkeit, in Echtzeit auf menschliche Emotionen und unerwartete Antworten zu reagieren, setzt Empathie voraus, die KI-Systemen fehlt. Laut Snowflake-Report 2025 berichten 77 Prozent der europäischen Unternehmen, dass KI netto mehr Jobs schafft als vernichtet. Aber das hängt davon ab, wie aktiv Redaktionen in Umschulung und Workflow-Redesign investieren.

Was ist die beste KI für Journalisten?

Es gibt keine universell beste KI für Journalisten, weil verschiedene Tools verschiedene Stärken haben. Für quellenbasierte Recherche: Perplexity AI. Für Textentwürfe und Brainstorming: ChatGPT (GPT-4o) oder Claude. Für DSGVO-konforme Anwendungen im DACH-Raum: Aleph Alpha (deutsches Unternehmen, EU-Datenspeicherung) oder Neuroflash für deutschsprachige Texte. Die Entscheidung sollte immer vom konkreten Workflow-Schritt abhängen, nicht vom Hype um ein bestimmtes Tool. Achtung: Seit dem EU AI Act (Februar 2025) müssen Medienhäuser dokumentieren, welche KI-Systeme sie einsetzen und zu welchem Zweck.

Wie wird ChatGPT im Journalismus eingesetzt?

ChatGPT wird in Redaktionen vor allem für vier Aufgaben genutzt: Erstellen von Textentwürfen und Strukturvorschlägen für Artikel, Übersetzungen und sprachliche Überarbeitungen, Generierung von Social-Media-Adaptionen bestehender Artikel sowie als Brainstorming-Partner für Themenentwicklung. Was ChatGPT nicht gut kann: aktuelle Ereignisse ohne Web-Browsing, tiefe Fachrecherche in spezialisierten Nischen und faktengesicherte Berichterstattung ohne menschliche Prüfung. Jeder ChatGPT-Output muss von einem Redakteur geprüft werden, bevor er veröffentlicht wird. Punkt. Im Hinblick auf DSGVO ist bei der Eingabe von personenbezogenen Daten oder vertraulichen Quellen besondere Vorsicht geboten, da OpenAI US-amerikanisches Recht unterliegt.