Während du gerade überlegst, ob der Auftragsverarbeitungsvertrag mit deinem KI-Anbieter wirklich DSGVO-konform ist, hat dein US-amerikanischer Wettbewerber gerade seinen Content-Workflow vollständig automatisiert und seine Produktionskosten halbiert. Das ist keine Übertreibung. Aus meiner Arbeit mit über 200 KI-Startups bei AI NATION sehe ich dieses Muster ständig: Deutsche Unternehmen verbringen sechs Monate in Compliance-Meetings, während andere Märkte einfach loslegen. Bei der Frage "KI DSGVO" nennen 73 % der deutschen Unternehmen Datenschutz als die größte Hürde bei der KI-Adoption. Das Problem? Ein Großteil dieser KI DSGVO-Hürden ist längst lösbar. Aber niemand erklärt dir, wie.

Ganz ehrlich: Die DSGVO ist kein Feind der KI-Nutzung. Sie ist ein Rahmen. Und innerhalb dieses Rahmens gibt es, wie KI-Berater von go-ai-smart.com treffend formulieren, "viele Möglichkeiten, generative KI produktiv und rechtskonform einzusetzen". Du musst nur wissen, wo die Grenzen liegen und was du konkret tun musst. Genau darum geht es in diesem Artikel.

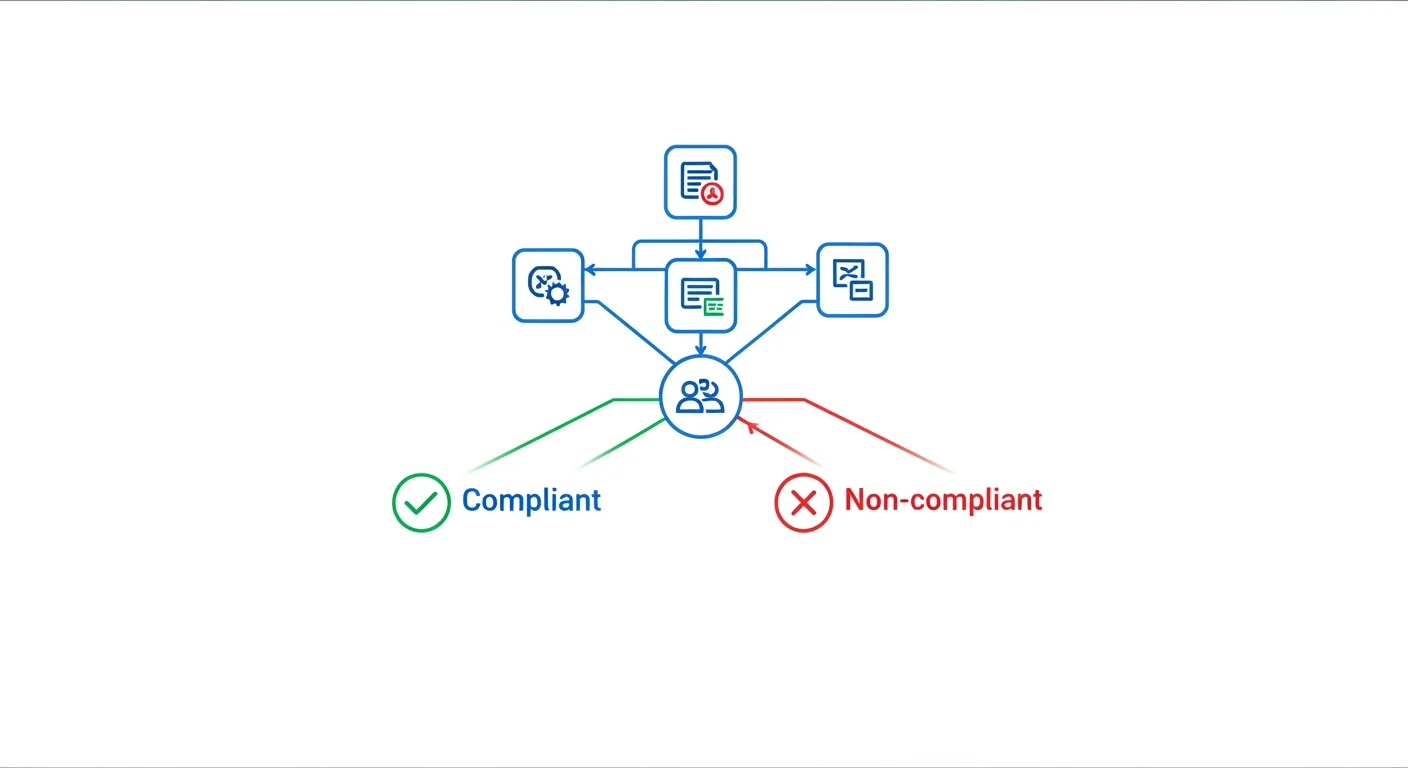

Kurze Antwort: KI-Tools für Content-Erstellung sind DSGVO-konform nutzbar, aber nur wenn du einen Auftragsverarbeitungsvertrag (AVV) abgeschlossen hast, keine personenbezogenen Daten ohne Rechtsgrundlage eingibst und Drittlandtransfers bewusst steuerst. Kundendaten in öffentliche KI-Tools einzugeben ist ohne AVV schlicht nicht erlaubt.

⚡ TL;DR – Die wichtigsten Erkenntnisse:

- ✅ KI-Tools sind DSGVO-konform nutzbar, aber nur mit AVV, Rechtsgrundlage und bewusstem Umgang mit Drittlandtransfers.

- ✅ Kundendaten dürfen ohne gültigen AVV und ohne Rechtsgrundlage nicht in KI-Tools eingegeben werden.

- ✅ Lokale Small Language Models (SLM) oder europäische Cloud-Anbieter sind die sicherste Lösung für maximale Datensouveränität.

- ✅ Der EU AI Act verschärft die Anforderungen zusätzlich: Transparenz und Kennzeichnung von KI-generierten Inhalten werden Pflicht.

Was die DSGVO konkret von dir verlangt, wenn du KI nutzt

Lass uns das Grundprinzip kurz klarstellen, bevor wir ins Detail gehen. Die DSGVO unterscheidet nicht zwischen "du nutzt KI" und "du nutzt keine KI". Sie fragt immer: Werden personenbezogene Daten verarbeitet? Wenn ja, brauchst du eine Rechtsgrundlage. Punkt.

Bei der Nutzung von KI-Tools für Content-Erstellung gibt es typischerweise zwei Szenarien. Erstes Szenario: Du gibst dem Tool nur allgemeine Informationen, Themen, Briefings ohne Bezug zu echten Personen. Hier ist das Datenschutzrisiko gering. Zweites Szenario: Du fütterst das Tool mit Kundendaten, Namen, E-Mail-Adressen, Gesprächsprotokollen, CRM-Einträgen. Das ist, wo es rechtlich ernst wird.

Für Szenario zwei brauchst du zwingend drei Dinge:

- Eine Rechtsgrundlage nach Art. 6 DSGVO: Das kann berechtigtes Interesse (Art. 6 Abs. 1 lit. f) sein, eine Einwilligung oder ein Vertrag. Ohne eine dieser Grundlagen: kein Go.

- Einen Auftragsverarbeitungsvertrag (AVV) nach Art. 28 DSGVO: Wenn dein KI-Anbieter personenbezogene Daten in deinem Auftrag verarbeitet, ist er Auftragsverarbeiter. Der AVV ist nicht optional.

- Transparenz gegenüber den Betroffenen: Deine Datenschutzerklärung muss den KI-Einsatz abdecken, wenn dabei personenbezogene Daten verarbeitet werden.

In meiner Erfahrung aus über 100 digitalen Projekten ist der fehlende AVV der häufigste Fehler. Unternehmen nutzen KI-Tools monatelang, ohne je geprüft zu haben, ob der Anbieter überhaupt einen ordentlichen AVV anbietet. Das ist ein Problem.

Was muss in den AVV? Die KI DSGVO-Mindestanforderungen im Überblick

Der AVV ist kein Bürokratie-Monster, wenn du weißt, worauf du achten musst. Art. 28 DSGVO schreibt vor, was drin sein muss. Hier ist das Wesentliche:

- Gegenstand und Dauer der Verarbeitung: Welche Daten werden wie lange verarbeitet?

- Art und Zweck der Verarbeitung: Wofür nutzt der Anbieter deine Daten, ausschließlich zur Erbringung des Dienstes?

- Art der personenbezogenen Daten und Kategorien der Betroffenen: Konkret benennen, was verarbeitet wird.

- Weisungsgebundenheit des Auftragsverarbeiters: Der Anbieter darf Daten nur nach deiner Weisung verarbeiten.

- Technische und organisatorische Maßnahmen (TOMs): Welche Sicherheitsmaßnahmen hat der Anbieter implementiert?

- Regelung zu Unterauftragsverarbeitern: Wer hat Zugriff auf die Daten, und hast du dem zugestimmt?

- Löschung oder Rückgabe der Daten: Was passiert mit deinen Daten nach Vertragsende?

Besonders wichtig beim Punkt Unterauftragsverarbeiter: Viele große KI-Anbieter nutzen Infrastruktur von AWS, Google Cloud oder Azure. Das bedeutet, du hast es plötzlich mit einer ganzen Kette von Verarbeitern zu tun. Alles muss im AVV geregelt sein. Anbieter wie PrivateGPT, die auf deutscher Infrastruktur mit ISO-27001-Zertifizierung operieren, lösen dieses Problem elegant: Die Kette ist kürzer und bleibt in Europa.

Klingt aufwendig? Naja, eigentlich nicht. Die meisten seriösen Enterprise-KI-Anbieter (ChatGPT Enterprise, Microsoft Copilot für Unternehmen, Google Workspace mit Gemini) bieten standardisierte AVV-Dokumente an. Du musst sie nur aktivieren und prüfen. Nicht selbst schreiben.

Darf ich Kundendaten in ein KI-Tool eingeben?

Das ist die praktische Frage, die mich am häufigsten erreicht. Und die ehrliche Antwort ist: Es kommt drauf an. Aber meistens: nicht ohne Vorbereitung.

Hier ist das Ding. "Kundendaten" ist ein breiter Begriff. Lass uns das aufdröseln:

- Anonymisierte oder aggregierte Daten (z.B. "Unsere Kunden kaufen hauptsächlich in Q4"): Kein Problem. Kein Personenbezug, keine DSGVO-Relevanz.

- Pseudonymisierte Daten (z.B. Kunden-IDs statt Namen): Grauzone. Wenn die Re-Identifizierung möglich ist, gilt die DSGVO trotzdem.

- Direkt personenbezogene Daten (Name, E-Mail, Adresse, Kaufhistorie): Nur mit AVV, Rechtsgrundlage und nach Datenschutz-Folgenabschätzung (DSFA) bei hohem Risiko.

Ein konkretes Beispiel aus der Praxis: Ein mittelständisches B2B-Unternehmen wollte KI nutzen, um personalisierte Vertriebsmails zu erstellen. Dafür sollten Daten aus dem CRM (Namen, Unternehmen, bisherige Interaktionen) in ChatGPT eingegeben werden. Ohne Enterprise-Vertrag und AVV wäre das ein klarer DSGVO-Verstoß gewesen. Mit aktiviertem Enterprise-Plan, AVV und angepasster Datenschutzerklärung: rechtlich sauber.

Die AISberg GmbH bringt es auf den Punkt: "Die Verantwortung, bei der Nutzung einer öffentlich zugänglichen KI, um DSGVO- und Cybersecurity-Verletzungen zu verhindern, liegt bei allen Nutzerinnen." Kein Tool-Anbieter übernimmt diese Verantwortung für dich. Das ist deine Aufgabe als Unternehmen.

Drittlandtransfers: Was passiert mit meinen Daten, wenn sie die EU verlassen?

Hier wird es heikel. Und das ist der Bereich, wo ich verstehe, warum so viele Unternehmen im DACH-Raum nervös werden.

Die meisten großen KI-Anbieter sitzen in den USA: OpenAI, Google, Microsoft (mit Ausnahmen). US-amerikanische Anbieter unterliegen dem Cloud Act, was bedeutet: US-Behörden können unter bestimmten Umständen Zugriff auf Daten fordern, auch wenn diese in Europa gespeichert sind. Das ist keine Theorie, das ist geltendes US-Recht.

Konsequenzen in der Praxis: Die Deutsche Forschungsgemeinschaft (DFG) hat bereits Forschungsdaten aus US-Clouds zurückgezogen. Schweizer Datenschützer empfehlen sogar ein breites Cloud-Verbot für AWS, Google und Microsoft. Das sind starke Signale.

Was kannst du tun? Drei Optionen:

- Option 1: EU-Standardvertragsklauseln (SCC) nutzen: Viele Anbieter bieten diese als Bestandteil des AVV an. Das ist der Minimalstandard für rechtmäßige Drittlandtransfers nach Art. 46 DSGVO.

- Option 2: Europäische Alternativen wählen: Anbieter mit Serverstandort in Deutschland oder der EU, idealerweise ISO-27001-zertifiziert. Das eliminiert das Drittlandproblem.

- Option 3: Lokale Small Language Models (SLM) betreiben: Daten verlassen dein Unternehmen nicht. Maximale Souveränität, kein Drittlandtransfer, volle Kontrolle. Der Nachteil? Höherer Einrichtungsaufwand und Infrastrukturkosten.

SLMs gewinnen im DACH-Raum gerade massiv an Bedeutung. Und das aus gutem Grund: Sie garantieren Datensouveränität, sind energieeffizienter als große LLMs und lassen sich auf Unternehmensanforderungen zuschneiden. Für Unternehmen mit sensiblen Kundendaten ist das oft die einzig sinnvolle Lösung.

EU AI Act: Was kommt zusätzlich zur DSGVO auf dich zu?

Der EU AI Act ist seit 2024 in Kraft und ergänzt die DSGVO um eine risikobasierte KI-Regulierung. Was das für dich als Content-ersteller mit KI-Tools bedeutet:

Generative KI-Systeme (also ChatGPT, Gemini, Copilot und Co.) fallen unter die Transparenzpflichten des AI Act. Konkret: KI-generierte Inhalte müssen als solche gekennzeichnet werden. Und wenn dein Tool Deepfakes oder synthetische Medien produziert, gelten noch strengere Regeln.

Für den typischen Marketing Manager im DACH-Raum sind vor allem zwei Punkte relevant:

- Kennzeichnungspflicht: KI-erstellte Texte, Bilder oder Videos, die öffentlich verbreitet werden, müssen als KI-generiert erkennbar sein. Das betrifft Social-Media-Posts, Blogartikel, Newsletter und Werbematerialien.

- Verbotene Praktiken: KI darf nicht für manipulative Techniken eingesetzt werden, die das Verhalten von Personen unbewusst beeinflussen. Das betrifft bestimmte Formen des Micro-Targetings.

Bußgelder unter dem EU AI Act? Bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes für Verstöße gegen verbotene Praktiken. Zum Vergleich: DSGVO-Bußgelder liegen bei bis zu 20 Millionen Euro oder 4 % des Umsatzes. Also, naja, kein kleines Thema.

| Kriterium | DSGVO | EU AI Act |

|---|---|---|

| Gilt seit | Mai 2018 | August 2024 (gestaffelt) |

| Fokus | Personenbezogene Daten | KI-Systeme und deren Risiken |

| Rechtsgrundlage nötig | Ja, immer | Risikobasiert (4 Stufen) |

| Kennzeichnungspflicht | Nein (direkt) | Ja, für generative KI-Outputs |

| Max. Bußgeld | 20 Mio. EUR / 4 % Umsatz | 35 Mio. EUR / 7 % Umsatz |

| AVV erforderlich | Ja, bei Auftragsverarbeitung | Indirekt (Transparenzpflichten) |

| Gilt für KI-Content-Tools | Ja, wenn personenbez. Daten | Ja, immer (Transparenz) |

| Drittlandtransfer geregelt | Ja (Art. 44 ff.) | Teilweise (Marktortprinzip) |

Risiken und typische Fehler, die du kennen solltest

Hier ist das, was in der Praxis schiefgeht. Ich meine, ich habe bei AI NATION über 200 Startups begleitet und in 26 Jahren digitaler Produktentwicklung einiges gesehen. Diese KI DSGVO-Fehler sind keine Theorie.

Fehler 1: Die kostenlose Version nutzen und Kundendaten eingeben. Klingt offensichtlich? Passiert trotzdem ständig. Die kostenlose Version von ChatGPT nutzt Eingaben standardmäßig zum Training. Das ist in den Nutzungsbedingungen versteckt und für Unternehmen mit personenbezogenen Daten schlicht inakzeptabel. Nur Enterprise-Versionen mit deaktiviertem Training und vorhandenem AVV sind für Unternehmensdaten geeignet.

Fehler 2: Den AVV aktivieren, aber keine interne Governance haben. Ein AVV schützt dich nur, wenn deine Mitarbeiter auch wissen, welche Daten sie eingeben dürfen. Ohne klare interne Richtlinien (AI Governance Policy) nutzt der beste Vertrag nichts. Ein einziger Mitarbeiter, der versehentlich Gesundheitsdaten eines Kunden eingibt, kann zum Datenschutzvorfall werden.

Fehler 3: Drittlandtransfer ignorieren. Nur weil ein Anbieter "DSGVO-konform" auf seiner Website schreibt, heißt das nicht, dass Drittlandtransfers geregelt sind. Prüfe immer: Wo stehen die Server? Gibt es SCC oder Binding Corporate Rules? Gilt der Cloud Act?

Fehler 4: Keine Datenschutz-Folgenabschätzung (DSFA) durchführen. Wenn du KI für die Verarbeitung von Daten in großem Umfang einsetzt oder besonders sensible Daten verarbeitest, ist eine DSFA nach Art. 35 DSGVO Pflicht. Das wird oft vergessen, bis der Datenschutzbeauftragte fragt.

Fehler 5: KI als Entschuldigungsgrund für Nicht-Handeln. Und hier wird es unbequem. Jeder 4. Deutsche hat Sorgen um Datenmissbrauch im Netz (Stand November 2025). Das ist verständlich. Aber die Realität ist: Unternehmen, die aus Datenschutzangst KI komplett meiden, verlieren Wettbewerbsvorteile. Mit 109.000 unbesetzten IT-Stellen in Deutschland (Bitkom) und einem nachgewiesenen Produktivitätspotenzial von 30 % (SAP) kann sich kein DACH-Unternehmen leisten, KI-Adoption auf unbestimmte Zeit zu verschieben. Compliance und Innovation schließen sich nicht aus.

Das gesagt: Diese Herangehensweise funktioniert am besten für kleine bis mittelgroße Teams mit klarer interner Kommunikation. Bei sehr komplexen Datenstrukturen oder regulierten Branchen (Gesundheit, Finanzen) empfehle ich immer, einen Datenschutzexperten hinzuzuziehen. Wenn es um KI DSGVO-Compliance geht, ist das keine Schwäche, das ist Pragmatismus.

Häufig gestellte Fragen (FAQ)

Ist KI DSGVO-konform?

Nicht pauschal. Es hängt davon ab, welches Tool du nutzt, wie du es konfigurierst und welche Daten du eingibst. Öffentliche KI-Tools ohne AVV und mit aktivem Modell-Training auf Nutzereingaben sind für personenbezogene Daten nicht geeignet. Enterprise-Versionen mit deaktiviertem Training, abgeschlossenem AVV und geregelten Drittlandtransfers (SCC oder EU-Serverstandort) können DSGVO-konform sein. Lokale SLMs, die auf deiner eigenen Infrastruktur laufen, sind die sicherste Option. Die Verantwortung liegt immer beim Unternehmen, nicht beim Tool-Anbieter.

Ist ChatGPT DSGVO-konform?

Die kostenlose Version: Nein, nicht für personenbezogene Kundendaten. ChatGPT Enterprise mit deaktiviertem Modell-Training und aktiviertem AVV (Data Processing Agreement): grundsätzlich möglich, aber du musst die US-Cloud-Risiken durch den Cloud Act bewerten. Die DFG hat bereits Forschungsdaten aus US-Clouds zurückgezogen, weil genau diese Risiken real sind. Für maximale Sicherheit: europäische Alternativen oder lokale Modelle bevorzugen.

Was hat KI mit Datenschutz zu tun?

KI-Systeme verarbeiten oft personenbezogene Daten, sowohl beim Training der Modelle als auch in den Eingaben der Nutzer. Die DSGVO verlangt Transparenz über diese Verarbeitung, eine Rechtsgrundlage und das Recht der Betroffenen auf Löschung. Der EU AI Act ergänzt das um eine Kennzeichnungspflicht für KI-generierte Inhalte und klassifiziert KI-Systeme nach Risikoklassen. Zusammen bilden DSGVO und EU AI Act den regulatorischen Rahmen für KI-Einsatz in Europa.

Ist Copilot DSGVO-konform?

Microsoft Copilot in der Enterprise-Version (Microsoft 365 Copilot mit aktiviertem DPA und EU Data Boundary) ist unter bestimmten Bedingungen DSGVO-konform einsetzbar. Die öffentliche Copilot-Version ohne Enterprise-Vertrag ist für personenbezogene Unternehmensdaten nicht geeignet. Schweizer Datenschutzbehörden empfehlen für maximale Sicherheit lokale Alternativen. Prüfe immer: Ist das EU Data Boundary aktiviert? Gibt es einen AVV? Werden Daten zum Training verwendet?